Novo guia mostra como configurar o agente de IA “local-first” para executar LLMs localmente com alto desempenho e mais privacidade em GPUs GeForce RTX e no DGX Spark.

A NVIDIA publicou um novo guia passo a passo que mostra como executar o OpenClaw localmente em PCs com GPUs GeForce RTX e NVIDIA RTX, além do NVIDIA DGX Spark. O OpenClaw é um agente de IA “local-first” em rápido crescimento, que pode rodar continuamente na máquina do usuário, atuando como um assistente pessoal com acesso a arquivos locais, e-mails e aplicativos pessoais.

O guia detalha como configurar o ambiente no Windows via WSL, modelos de linguagem (LLMs) localmente com ferramentas como LM Studio ou Ollama, e escolher os modelos recomendados conforme a capacidade de memória da GPU — desde modelos menores de 4B de parâmetros em GPUs com 8–12 GB até o gpt-oss-120B no NVIDIA DGX Spark com 128 GB de memória.

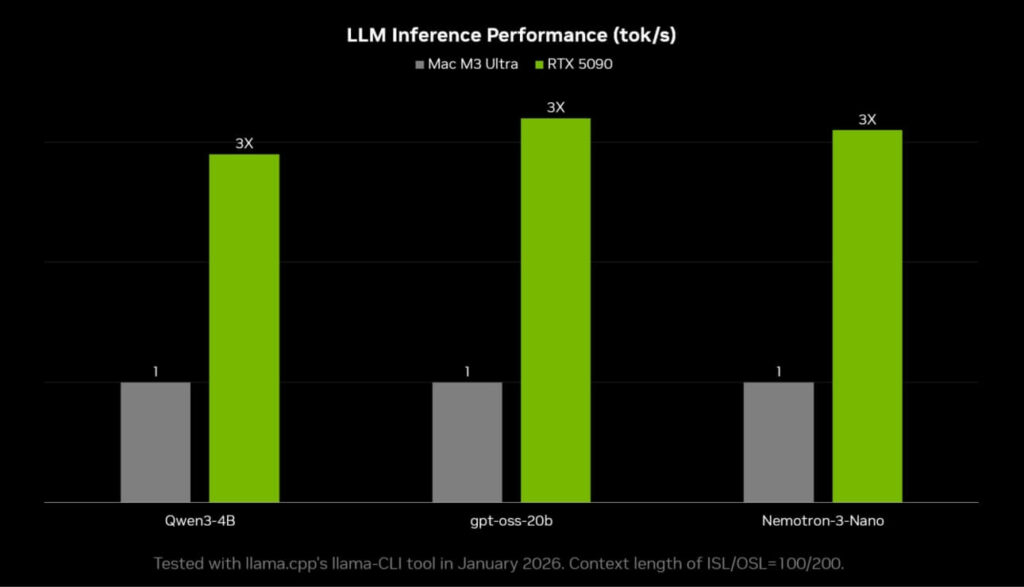

Como o OpenClaw foi projetado para operar de forma contínua, a execução local se torna especialmente vantajosa. As GPUs RTX aceleram a inferência de LLMs por meio de Tensor Cores e de ferramentas otimizadas com CUDA, como Llama.cpp e Ollama, possibilitando fluxos de trabalho agentivos mais responsivos, sem a necessidade de enviar dados sensíveis para a nuvem.

Com o OpenClaw, usuários podem automatizar a redação de e-mails, gerenciar compromissos no calendário e acompanhar projetos proativamente. O agente também consegue gerar relatórios de pesquisa combinando buscas na web com o contexto personalizado de arquivos locais.